Les projets de communication unifiée ne se limitent plus aux appels vocaux, aux extensions SIP ou à une seule console de dispatching. Dans les environnements réels de commandement et de contrôle, une plateforme moderne doit souvent connecter des systèmes de vidéosurveillance, des radios bidirectionnelles, des terminaux mobiles, des téléphones d’urgence, des systèmes de diffusion, des alarmes de contrôle d’accès et des plateformes tierces. L’objectif est simple : réunir différentes ressources de communication dans une interface unique pour surveiller, appeler, dispatcher, enregistrer et coordonner la réponse.

Pourtant, la mise en œuvre est rarement simple. De nombreux projets rencontrent deux blocages majeurs pendant l’intégration. Le premier est l’incompatibilité des protocoles, surtout lorsque les équipements et réseaux utilisent GB/T28181, RTMP, RTSP, ONVIF, PDT, DMR, SIP, des protocoles radio privés ou des interfaces propres aux fabricants. Le second est l’incompatibilité des codecs vidéo, notamment lorsque certaines plateformes de dispatching, navigateurs, terminaux mobiles, murs d’images ou anciens décodeurs ne gèrent pas correctement les flux H.265.

Si ces problèmes ne sont pas correctement traités, la plateforme peut subir des échecs d’accès aux équipements, des aperçus vidéo instables, des écrans noirs, des gels d’image, des mosaïques, des réponses tardives et une mauvaise expérience utilisateur. Dans le dispatching d’urgence, la sécurité industrielle, la sécurité publique, les transports, l’énergie, les mines, les ports et les grands campus, ce ne sont pas de petits détails techniques. Ils influencent directement l’efficacité du commandement et la continuité opérationnelle.

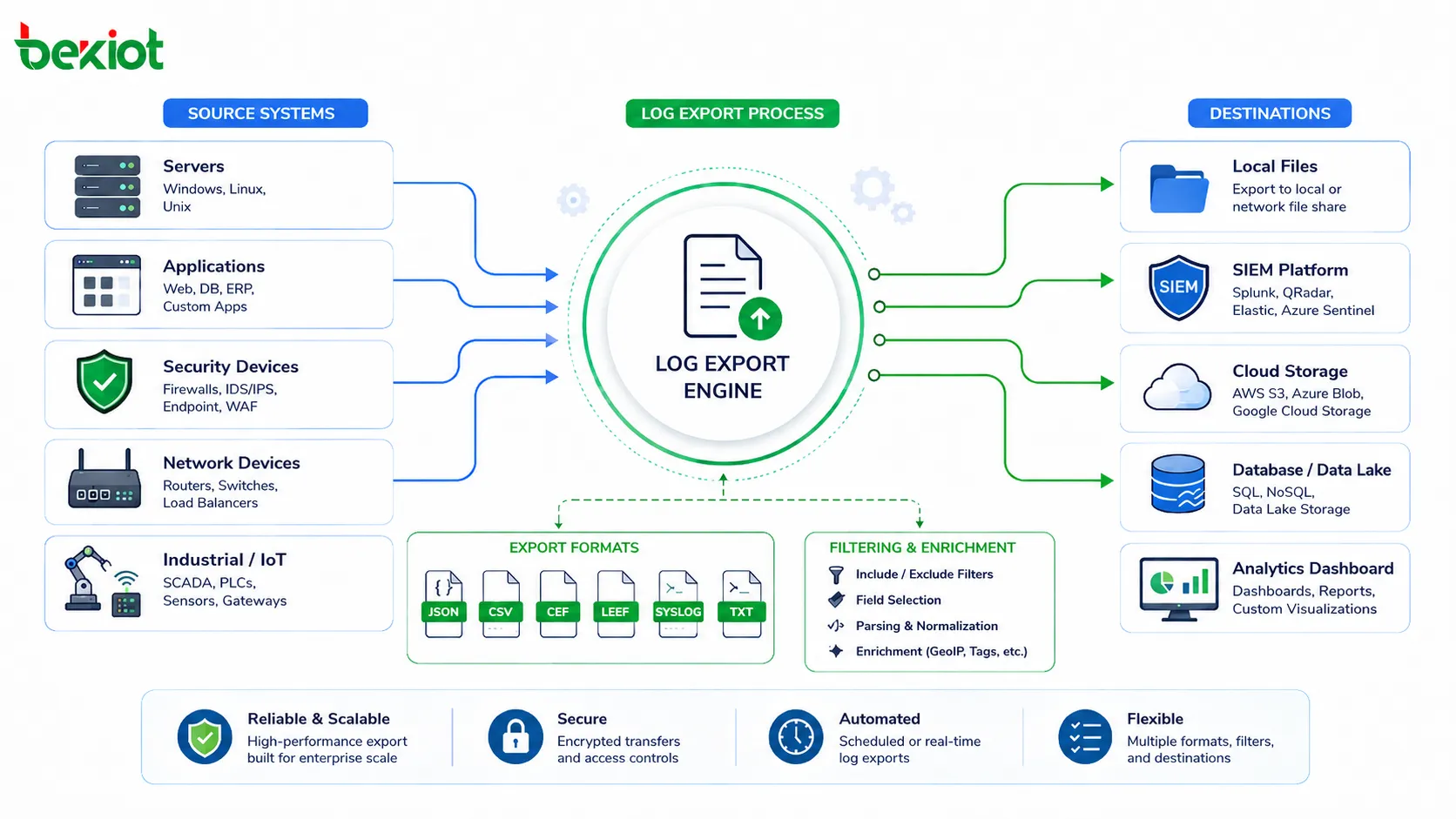

La solution pratique n’est pas de remplacer tous les équipements ni de reconstruire tout le système. Dans de nombreux cas, la bonne architecture consiste à utiliser des passerelles dédiées et des services de transcodage comme couche intermédiaire. Les passerelles de protocole convertissent les accès non standard ou hétérogènes en interfaces reconnues par la plateforme. Les serveurs de transcodage vidéo convertissent en temps réel les flux H.265 en H.264 ou dans d’autres formats compatibles. Ainsi, les problèmes complexes de compatibilité sont traités en périphérie du système plutôt que sur chaque terminal.

Le vrai défi derrière la convergence des systèmes

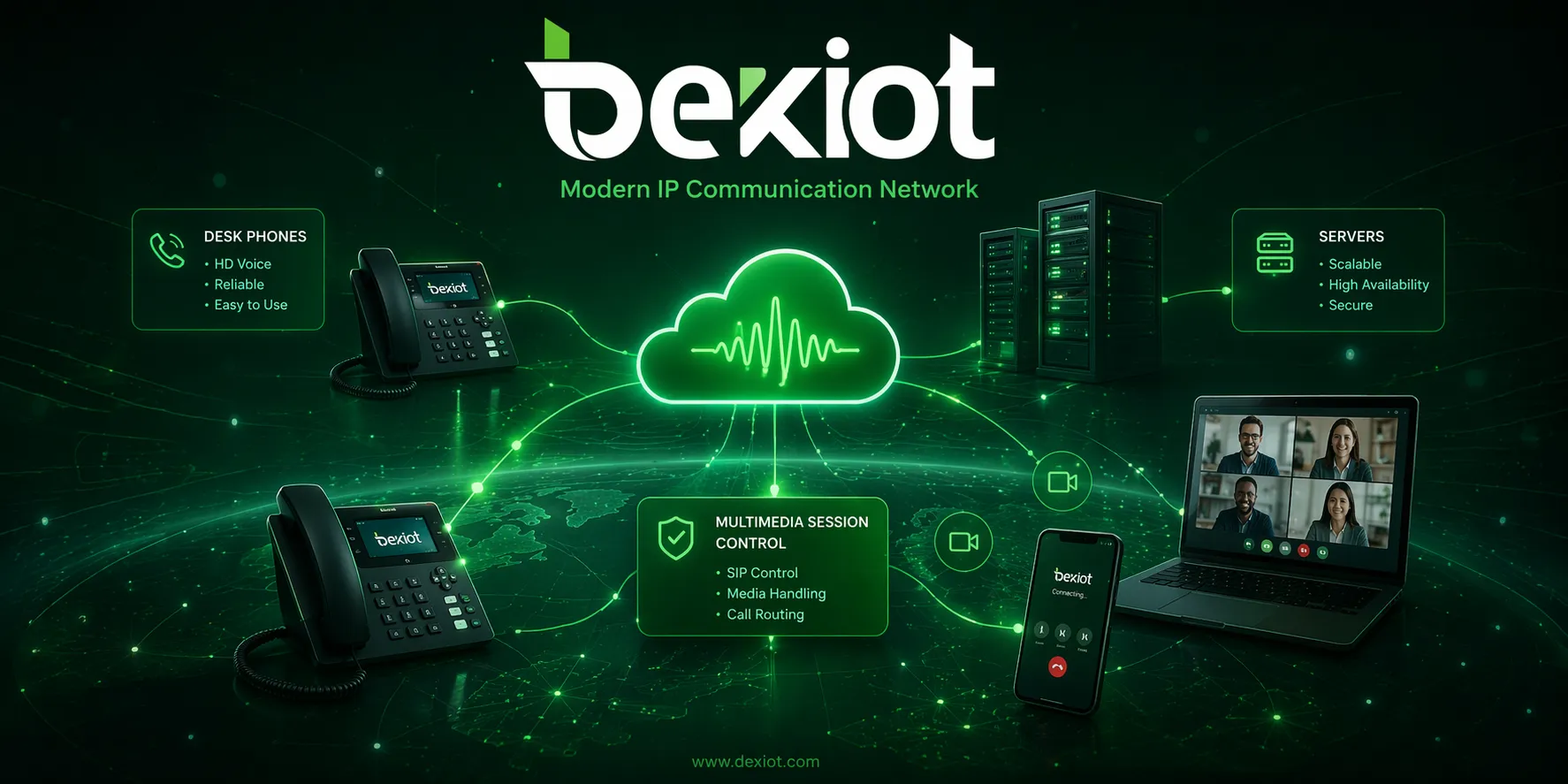

L’expression « communication unifiée » semble simple, mais les projets réels rassemblent de nombreux systèmes qui n’ont pas été conçus pour fonctionner ensemble. Un système vidéo peut utiliser GB/T28181, RTSP, ONVIF ou RTMP. Un réseau radio peut utiliser PDT, DMR, la radio analogique ou une interface trunking privée. Un téléphone d’urgence peut utiliser SIP. Un système de sonorisation peut exiger une commande de paging. Une plateforme de commandement peut nécessiter localisation GIS, aperçu vidéo, dispatching audio, liaison d’alarme et enregistrement.

Chaque système a sa propre logique de communication. Certains équipements sont conçus pour le streaming vidéo, d’autres pour le dispatching vocal, d’autres pour la radio privée, et d’autres pour déclencher des alarmes ou remonter des événements. Déployés séparément, ils peuvent bien fonctionner dans leurs limites. La difficulté apparaît quand le projet exige qu’ils travaillent comme un réseau de communication coordonné.

C’est pourquoi beaucoup de projets échouent au niveau de l’accès. La plateforme peut être riche en fonctions, mais ne pas comprendre directement chaque protocole. L’équipement peut fonctionner, mais ne pas envoyer médias ou signalisation dans un format accepté. Le résultat est une « île de communication » : chaque système marche seul, mais le centre de commandement ne peut pas utiliser toutes les ressources dans un même flux de travail.

Quand les équipements parlent des protocoles différents

L’incompatibilité des protocoles est l’un des problèmes les plus fréquents. Une plateforme de commandement peut devoir recevoir la vidéo de caméras, la voix de réseaux radio, des alarmes d’équipements de terrain et des flux multimédias de terminaux distants. Ces ressources peuvent provenir de fournisseurs, secteurs et générations technologiques différents.

Par exemple, de nombreux systèmes de vidéosurveillance utilisent GB/T28181 pour l’accès et le contrôle vidéo. Certains équipements utilisent RTMP, RTSP ou ONVIF pour le transport de flux et la gestion. Les systèmes radio peuvent utiliser PDT ou DMR. SIP est largement utilisé pour la VoIP, l’interphonie, la voix de dispatching et la diffusion IP. Sans couche de conversion, ces protocoles ne sont pas toujours reconnus directement par une même plateforme.

Une erreur courante consiste à attendre de la plateforme centrale qu’elle prenne en charge tous les protocoles possibles. Cela paraît pratique au départ, mais rend la plateforme lourde, difficile à maintenir et dépendante de nombreuses interfaces sur mesure. Une architecture plus souple consiste à placer des passerelles dédiées entre les systèmes de terrain et la plateforme. Chaque passerelle convertit les protocoles d’un type d’équipement ou de réseau.

Utiliser les passerelles comme pont d’intégration

Une passerelle agit comme un pont entre le système de terrain et la plateforme de communication unifiée. Elle reçoit médias, signalisation, commandes de contrôle ou états d’un côté, puis les convertit dans un format compréhensible par l’autre côté. Elle masque ainsi la complexité à la plateforme centrale et réduit les personnalisations profondes sur chaque équipement.

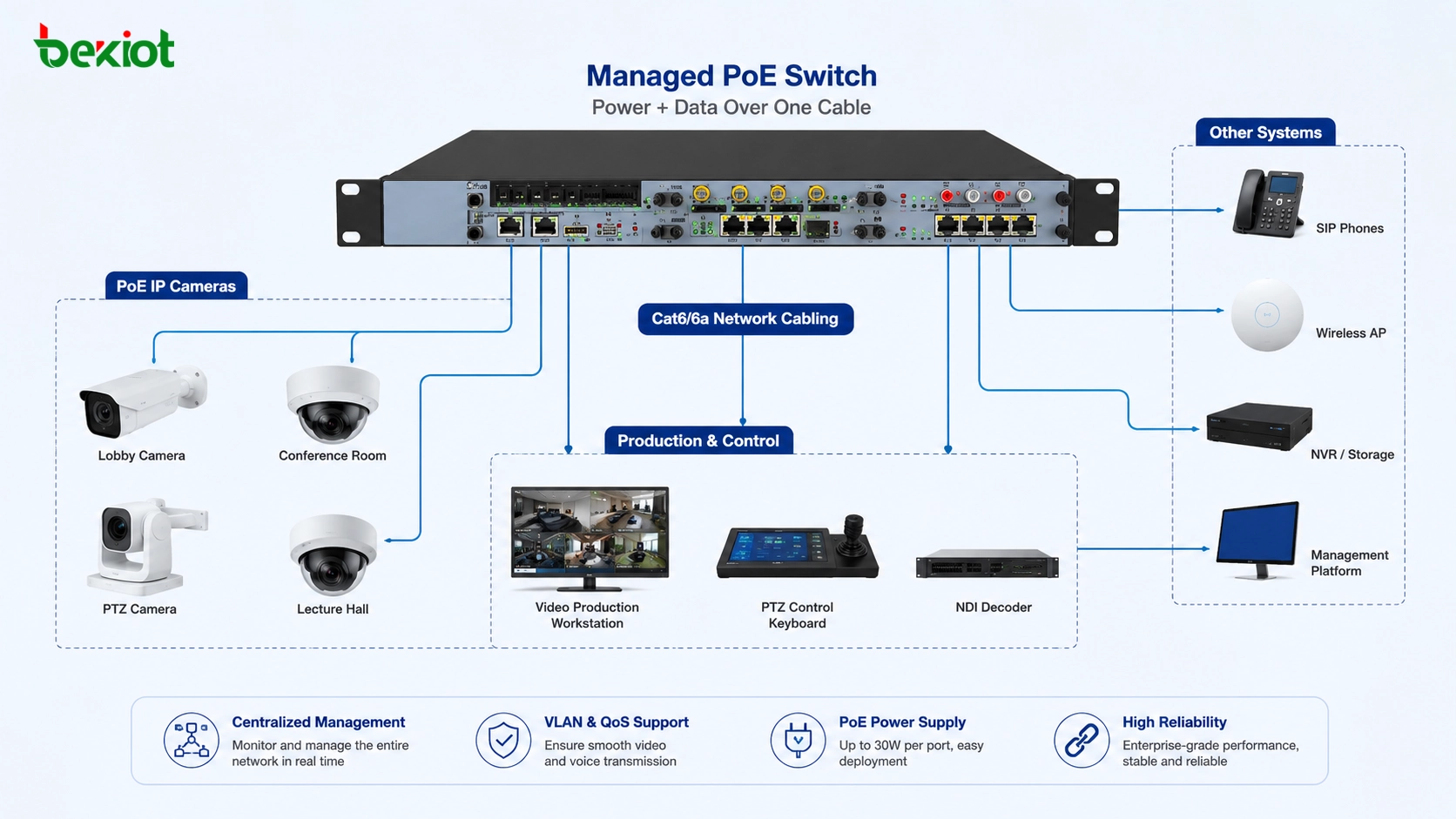

Pour l’accès vidéo, une passerelle vidéo peut connecter caméras, NVR, plateformes vidéo, terminaux vidéo distants ou autres sources via GB/T28181, RTMP, RTSP, ONVIF ou interfaces propriétaires. Elle peut ensuite transférer les flux vers la plateforme de dispatching dans un format standardisé. Les opérateurs peuvent alors prévisualiser, commuter, enregistrer et distribuer la vidéo dans un seul système.

Pour la radio, une passerelle trunking ou RoIP peut relier PDT, DMR, radio analogique ou autres réseaux bidirectionnels à une plateforme de dispatching IP. Les dispatchers peuvent parler avec les utilisateurs radio depuis une console logicielle, un téléphone SIP, un micro de centre de commandement ou un terminal mobile. La voix radio peut aussi être enregistrée, gérée et liée aux autres ressources d’urgence.

Pour les systèmes voix et interphonie, les passerelles SIP et IP peuvent connecter téléphones analogiques, bornes d’appel d’urgence, téléphones IP, terminaux de diffusion et serveurs de dispatching. Dans les scénarios industriels, Becke Telcom peut être envisagé pour les projets qui demandent dispatching SIP, téléphones industriels, interphonie d’urgence, liaison de diffusion et intégration de passerelles radio dans une même architecture.

Pourquoi la compatibilité H.265 devient critique

Le second grand blocage est la compatibilité des codecs vidéo. H.265, ou HEVC, réduit la bande passante par rapport à H.264 à qualité comparable. Il est donc attractif pour la surveillance haute définition, la transmission longue distance, le monitoring distant et les grands systèmes vidéo. Mais il exige aussi plus de capacité de décodage et un support logiciel plus large.

Dans les projets réels, tous les terminaux ne décodent pas H.265 correctement. Certaines plateformes de dispatching, navigateurs, mobiles, anciens décodeurs, murs d’images ou terminaux embarqués ne prennent en charge que H.264 de manière fiable. Si un flux H.265 leur est envoyé directement, l’utilisateur peut voir un écran noir, un gel vidéo, un échec de décodage, une perte d’images ou des mosaïques.

Le problème est plus grave dans un centre de commandement, car la vidéo ne sert pas seulement à regarder. Elle peut soutenir la vérification d’urgence, le suivi d’incident, l’inspection distante, la décision de dispatching et l’analyse après événement. Si la vidéo ne s’ouvre pas rapidement en urgence, tout le flux de communication perd en efficacité.

Le transcodage comme couche pratique de compatibilité

La solution la plus pratique consiste à déployer un serveur de transcodage vidéo entre la source et la plateforme. Il reçoit le flux original, le décode et le convertit dans un format que le système cible peut lire correctement. Dans beaucoup de projets, cela signifie convertir H.265 en H.264.

Cette approche évite de remplacer caméras, plateformes vidéo, terminaux d’affichage ou mobiles existants. Elle évite aussi d’obliger la plateforme de dispatching à gérer directement chaque variation de codec. La couche de transcodage devient un point contrôlé où débit, fréquence d’images, résolution, format de flux et compatibilité de sortie sont ajustés selon les besoins du projet.

Par exemple, un flux H.265 haute définition peut être converti en flux H.264 à plus faible débit pour mobile, tandis qu’un autre flux plus détaillé est envoyé au mur d’images. Un flux de monitoring distant peut être converti et distribué à plusieurs utilisateurs. Un flux de surveillance peut être optimisé pour le navigateur. Cette flexibilité améliore compatibilité et expérience utilisateur.

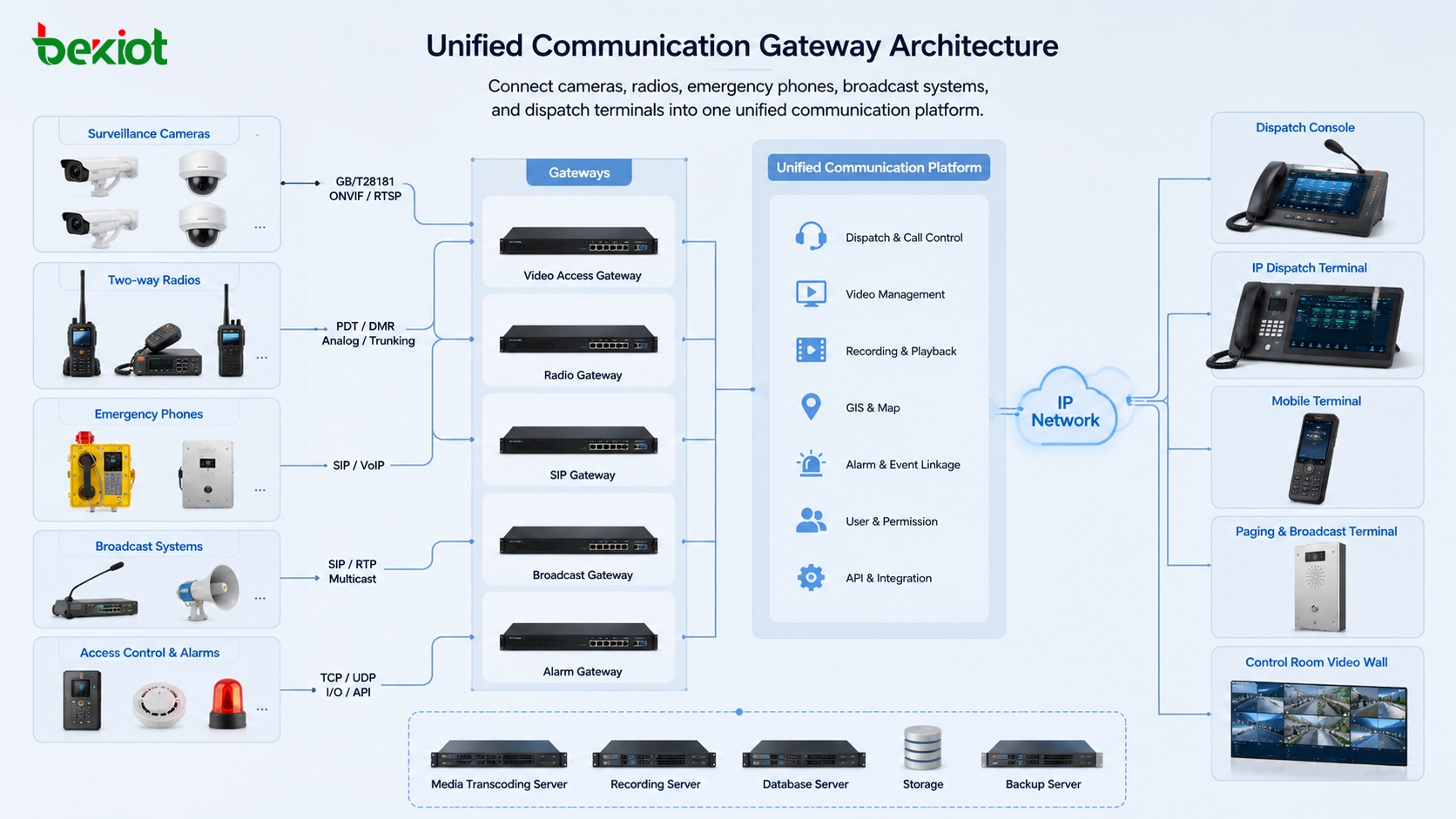

Concevoir une architecture unifiée d’accès média

Un bon système doit séparer accès, conversion, contrôle et application. La couche d’accès connecte caméras, radios, téléphones d’urgence, alarmes et terminaux de diffusion. La couche passerelle gère la conversion des protocoles et l’adaptation média. La plateforme centrale gère permissions, logique de dispatching, enregistrement, routage, événements et liaisons système. La couche application fournit consoles, apps mobiles, clients web, murs d’images et tableaux de bord.

Cette architecture en couches est plus facile à faire évoluer et à maintenir. Lorsqu’un nouveau type d’équipement est ajouté, il n’est pas nécessaire de redessiner toute la plateforme. Il suffit d’ajouter ou de configurer la passerelle appropriée. Si un nouveau codec pose problème, on met à jour la couche de transcodage. Si un nouveau flux métier est requis, la plateforme intègre les médias et la signalisation par interfaces standard.

En déploiement, l’architecture peut inclure passerelle vidéo, passerelle radio, serveur SIP, plateforme de dispatching, serveur de transcodage, serveur d’enregistrement, module de liaison d’alarme, module cartographique GIS et gestion des utilisateurs. La configuration dépend du secteur, mais le principe reste le même : résoudre l’hétérogénéité en périphérie et garder la plateforme centrale stable.

Valeur pour les centres de commandement et de dispatching

Les centres de commandement ont besoin de visibilité temps réel et de communication fiable. Les opérateurs peuvent devoir voir une caméra, parler à une équipe terrain par radio, déclencher une diffusion d’urgence, appeler une extension SIP, voir une position GIS et enregistrer l’événement. Si les systèmes sont séparés, ils passent d’un écran à l’autre, ce qui ralentit la réponse et augmente les erreurs.

Une architecture basée sur des passerelles fait apparaître les ressources dans une seule interface. Le dispatcher accède à la vidéo, à la voix, à l’interphonie, aux alarmes et à la diffusion depuis la même plateforme. Lorsqu’une alarme se déclenche, le système peut afficher les caméras proches, ouvrir un canal vocal, prévenir l’équipe concernée et enregistrer l’événement. C’est la vraie valeur de la convergence.

Pour les parcs industriels, sites énergétiques, hubs de transport, mines, campus, ports et organismes de sécurité publique, le bénéfice n’est pas seulement pratique. Il accélère la réponse d’urgence, réduit les zones aveugles, améliore la visibilité des ressources et soutient la gestion centralisée de plusieurs sous-systèmes.

Points clés avant le déploiement

Avant d’implémenter une solution, les équipes doivent évaluer tous les équipements et systèmes existants : protocoles vidéo, protocoles audio, types de réseaux radio, codecs, résolutions, bande passante, interfaces de contrôle, rôles utilisateurs, politiques de sécurité et exigences d’enregistrement. Un inventaire clair détermine les passerelles et services de transcodage nécessaires.

La planification de la bande passante est essentielle. Les flux vidéo consomment beaucoup de ressources, surtout lorsque des flux haute résolution sont distribués à plusieurs utilisateurs. H.265 réduit la bande passante, mais tous les terminaux ne le décodent pas. H.264 est plus compatible, mais peut exiger plus de bande passante à qualité égale. Une conception pratique peut utiliser plusieurs profils de flux selon les terminaux et conditions réseau.

La latence doit aussi être étudiée. Le dispatching vocal et l’interphonie d’urgence nécessitent un faible délai. L’aperçu vidéo doit être assez fluide pour décider. Le transcodage ajoute parfois du délai ; le système doit donc équilibrer compatibilité, qualité et temps réel. L’accélération matérielle, le routage optimisé et le bon dimensionnement des serveurs aident à maintenir la performance.

Exigences de sécurité et de fiabilité

Les plateformes unifiées traitent souvent des données sensibles. Vidéo, voix radio, appels d’urgence, commandes de dispatching et alarmes peuvent passer par le même système. La sécurité doit donc être conçue dès le départ : contrôle d’accès, authentification, chiffrement, autorisation des équipements, audit des journaux et segmentation réseau sont importants.

La fiabilité est tout aussi importante. Les passerelles et serveurs de transcodage deviennent des nœuds clés. Si une passerelle tombe, certains équipements deviennent indisponibles. Si le serveur de transcodage tombe, la lecture vidéo peut être affectée. Les projets critiques doivent inclure redondance, basculement, supervision de santé, alimentation de secours et remontée d’alarme.

Un système bien conçu doit aussi offrir une supervision centralisée. Les administrateurs doivent voir l’état des équipements, des passerelles, des flux, du CPU, de la bande passante, du stockage et des alarmes. Cela permet de détecter tôt les problèmes et de réduire la difficulté de maintenance.

Intégration des terminaux industriels et des plateformes

Dans les projets impliquant voix industrielle, interphonie SIP, communication d’urgence, liaison de dispatching, intégration radio et notification par sonorisation, le choix des terminaux et plateformes doit suivre les besoins réels du site. Il ne s’agit pas d’imposer un seul produit partout, mais d’associer téléphones SIP, téléphones industriels, passerelles, plateformes de dispatching et terminaux de diffusion selon l’environnement, le réseau et le processus d’urgence.

Par exemple, un site industriel peut utiliser une plateforme unifiée pour connecter opérateurs de salle de contrôle, équipes de maintenance, utilisateurs radio, vidéosurveillance, téléphones d’urgence et zones de diffusion. Dans cette architecture, appels SIP, interphonie, paging, liaison d’alarme et communication en environnement difficile travaillent ensemble, tandis que passerelles et transcodage gèrent les compatibilités.

Pour les équipes d’ingénierie, le meilleur design n’est pas celui qui affiche le plus de fonctions sur le papier. C’est celui qui connecte les vrais équipements de terrain, convertit les protocoles incompatibles, lit la vidéo sans heurts et soutient des décisions rapides sous pression.

Cadre de solution recommandé

Une solution pratique doit commencer par un relevé des équipements et protocoles. L’équipe doit identifier les systèmes à connecter, leurs protocoles, les formats média produits et ce que la plateforme doit afficher ou contrôler. Cette étape détermine le besoin en passerelle vidéo, passerelle radio, passerelle SIP, serveur de transcodage ou module API.

L’étape suivante consiste à construire le pont média et signalisation. Les sources vidéo doivent passer par une passerelle vidéo lorsque possible. Les systèmes radio doivent passer par une passerelle radio ou RoIP. Les appareils SIP doivent s’enregistrer sur le serveur SIP ou la plateforme. Les flux H.265 doivent être transcodés lorsque les terminaux cibles ne les décodent pas de manière fiable.

La dernière étape consiste à unifier les opérations dans la couche application. Les dispatchers ne doivent pas comprendre les détails de protocole. Ils doivent pouvoir choisir une caméra, appeler une équipe terrain, ouvrir un canal radio, déclencher une diffusion, voir une alarme et gérer un événement depuis une interface unique. La complexité doit rester derrière la plateforme, traitée par passerelles, serveurs de transcodage et services d’intégration.

Conclusion

Les deux grands défis des projets de communication unifiée sont l’incompatibilité des protocoles et celle des codecs vidéo. Plusieurs types d’équipements, normes d’accès, réseaux radio, systèmes de surveillance, téléphones d’urgence et plateformes de dispatching ne peuvent pas toujours communiquer directement. Les flux H.265 peuvent aussi provoquer écrans noirs, gels, erreurs de décodage ou mosaïques sur des terminaux non compatibles.

La solution la plus efficace consiste à utiliser des passerelles dédiées et des services de transcodage vidéo comme couche d’intégration. Les passerelles convertissent les protocoles hétérogènes dans des formats reconnus par la plateforme. Les serveurs de transcodage convertissent H.265 en H.264 ou autres formats compatibles, en ajustant débit, fréquence d’images et résolution si nécessaire.

Avec la bonne architecture, la communication unifiée devient plus qu’un ensemble de systèmes isolés. Elle devient un environnement pratique de commandement et de dispatching où vidéo, voix, radio, interphonie, diffusion, alarmes et ressources terrain travaillent ensemble. Pour les projets industriels, publics, transports, énergie, campus et entreprises, cette approche améliore compatibilité, efficacité de réponse et évolutivité.

Questions fréquentes

Quels sont les deux plus grands blocages dans les projets de communication unifiée ?

Les deux blocages les plus courants sont l’incompatibilité de protocoles et l’incompatibilité de codecs vidéo. La première apparaît lorsque différents systèmes utilisent GB/T28181, RTMP, RTSP, ONVIF, PDT, DMR, SIP ou des interfaces privées. La seconde apparaît lorsque la vidéo H.265 ne peut pas être décodée par terminaux, navigateurs, murs d’images ou systèmes anciens.

Comment les passerelles résolvent-elles les problèmes de compatibilité ?

Les passerelles servent de ponts de protocole. Elles reçoivent signaux, flux média ou commandes de contrôle d’un système et les convertissent dans un format reconnu par la plateforme unifiée. Cela permet d’intégrer caméras, radios, appareils SIP, téléphones d’urgence et systèmes de diffusion sans remplacer chaque équipement.

Pourquoi la vidéo H.265 est-elle difficile dans certains systèmes de dispatching ?

H.265 offre une compression efficace, mais exige plus de capacité de décodage et un support logiciel plus large. Certains terminaux prennent seulement H.264 en charge de manière fiable. Envoyés directement à des appareils incompatibles, les flux H.265 peuvent produire écrans noirs, gels, mosaïques ou échecs de lecture.

Quand faut-il déployer un serveur de transcodage vidéo ?

Il faut le déployer lorsque le système doit accéder à des sources H.265, mais que certains terminaux, navigateurs, plateformes ou écrans ne les décodent pas correctement. Le serveur convertit H.265 en H.264 et ajuste débit, fréquence d’images et résolution pour améliorer la compatibilité.

Quels sites ont le plus besoin de cette architecture ?

Elle est particulièrement utile pour parcs industriels, hubs de transport, sites énergétiques, mines, ports, campus, centres de sécurité publique et grands sites d’entreprise. Ces environnements doivent souvent connecter vidéosurveillance, radio, interphonie SIP, téléphones d’urgence, sonorisation, alarmes et applications de dispatching dans un même flux coordonné.