AI-RAN est devenu l’un des sujets les plus commentés dans les télécommunications. Certains le présentent comme la prochaine étape de l’évolution des réseaux sans fil, tandis que d’autres jugent le concept encore trop spéculatif tant que le modèle économique, la structure de coûts et l’architecture technique ne sont pas entièrement vérifiés. Pour comprendre AI-RAN, il faut dépasser le slogan et examiner la convergence entre RAN, calcul IA, architecture de puces, edge computing et stratégie 6G.

AI-RAN signifie Artificial Intelligence Radio Access Network. Il s’agit d’appliquer l’IA au réseau d’accès radio ou de construire une infrastructure capable de traiter de manière intégrée les charges de communication et les charges d’IA. Ce n’est pas seulement ajouter un logiciel d’IA dans une station de base ; l’idée est de transformer celle-ci en nœud intelligent de calcul en périphérie.

L’article présente AI-RAN sous l’angle de l’ingénierie : évolution du RAN traditionnel vers Open RAN, rôle des CPU, GPU, FPGA et ASIC, sens des notions AI for RAN, AI and RAN et AI on RAN, progrès portés par NVIDIA, SoftBank, Nokia, Ericsson, Huawei et ZTE, ainsi que les défis de déploiement que les opérateurs doivent anticiper.

Comprendre le RAN avant l’AI-RAN

RAN signifie Radio Access Network. Dans un réseau mobile, on distingue le cœur de réseau, le réseau de transport et le réseau d’accès radio. Le RAN est la couche qui relie smartphones, terminaux industriels, capteurs, véhicules et objets IoT au réseau de l’opérateur.

En 4G, une station de base était généralement constituée d’antennes, d’unités radio distantes RRU, d’unités de bande de base BBU et de leurs liaisons. L’antenne et la radio assuraient émission et réception, tandis que la BBU gérait modulation, démodulation, codage, décodage, estimation de canal et ordonnancement des ressources.

En 5G, l’architecture a évolué. L’antenne et la RRU ont été davantage intégrées dans l’AAU, ou Active Antenna Unit. Les fonctions BBU ont été séparées entre CU et DU. La CU traite surtout les fonctions non temps réel ; la DU traite le temps réel de bande de base. Cette séparation augmente la flexibilité, mais aussi la complexité.

Pourquoi le RAN est difficile à ouvrir et virtualiser

Le cœur de réseau a été plus simple à virtualiser car il traite routage, commutation, contrôle de session et gestion de services. Cela a favorisé la NFV. Le RAN est plus exigeant : la bande de base impose faible latence, forte densité de calcul, précision temporelle et performance déterministe.

Les stations de base traditionnelles étaient des systèmes fermés, avec ASIC personnalisés et logiciels propriétaires. Ce modèle de “boîte noire” était efficace car l’ASIC est optimisé pour une charge fixe. Pour la bande de base RAN, il apporte densité de calcul, faible consommation et latence stable.

Les opérateurs ont ensuite poussé vers des architectures ouvertes et white-box : découplage matériel/logiciel, interfaces standardisées et exécution des fonctions télécom sur serveurs et puces génériques. Cette tendance a donné C-RAN, O-RAN, vRAN, xRAN et Open RAN.

De C-RAN à Open RAN

En 4G, China Mobile a promu C-RAN, ou Centralized RAN. L’idée était de centraliser plusieurs BBU dans une salle technique et de créer un pool de bande de base, qui traite les charges de manière centralisée puis distribue les signaux aux unités radio distantes via fibre.

Open RAN va plus loin avec une architecture modulaire et des interfaces normalisées. RU, DU et CU peuvent venir de fournisseurs différents si les interfaces sont compatibles. Le logiciel de bande de base peut aussi quitter les puces dédiées pour s’exécuter sur x86 ou ARM.

Mais Open RAN révèle un problème d’ingénierie : les CPU génériques sont flexibles, mais peuvent consommer davantage, être moins efficaces et moins stables en latence que les ASIC dédiés. D’où les difficultés de nombreux déploiements Open RAN à grande échelle. Le RAN est à la fois un problème logiciel, temps réel et énergétique.

Pourquoi le GPU entre dans le débat RAN

La logique AI-RAN commence par les puces : CPU, GPU, FPGA et ASIC. Le CPU incarne le calcul général et Open RAN ; l’ASIC l’équipement télécom spécialisé ; le FPGA la flexibilité pour prototypes ou cas spécialisés ; le GPU devient la nouvelle force liée à l’IA.

La stratégie AI-RAN de NVIDIA consiste à introduire le calcul GPU dans les stations de base, non seulement pour accélérer la bande de base, mais aussi pour exécuter des modèles IA au bord du réseau. Une station capable de traiter RAN et IA devient une infrastructure d’IA en périphérie.

Le marché est considérable : les dépenses mondiales annuelles en équipements télécom dépassent 100 milliards USD. Si les GPU entrent dans l’architecture des stations de base, les réseaux télécom peuvent devenir un nouveau grand marché du calcul.

AI-RAN est plus qu’une station de base GPU

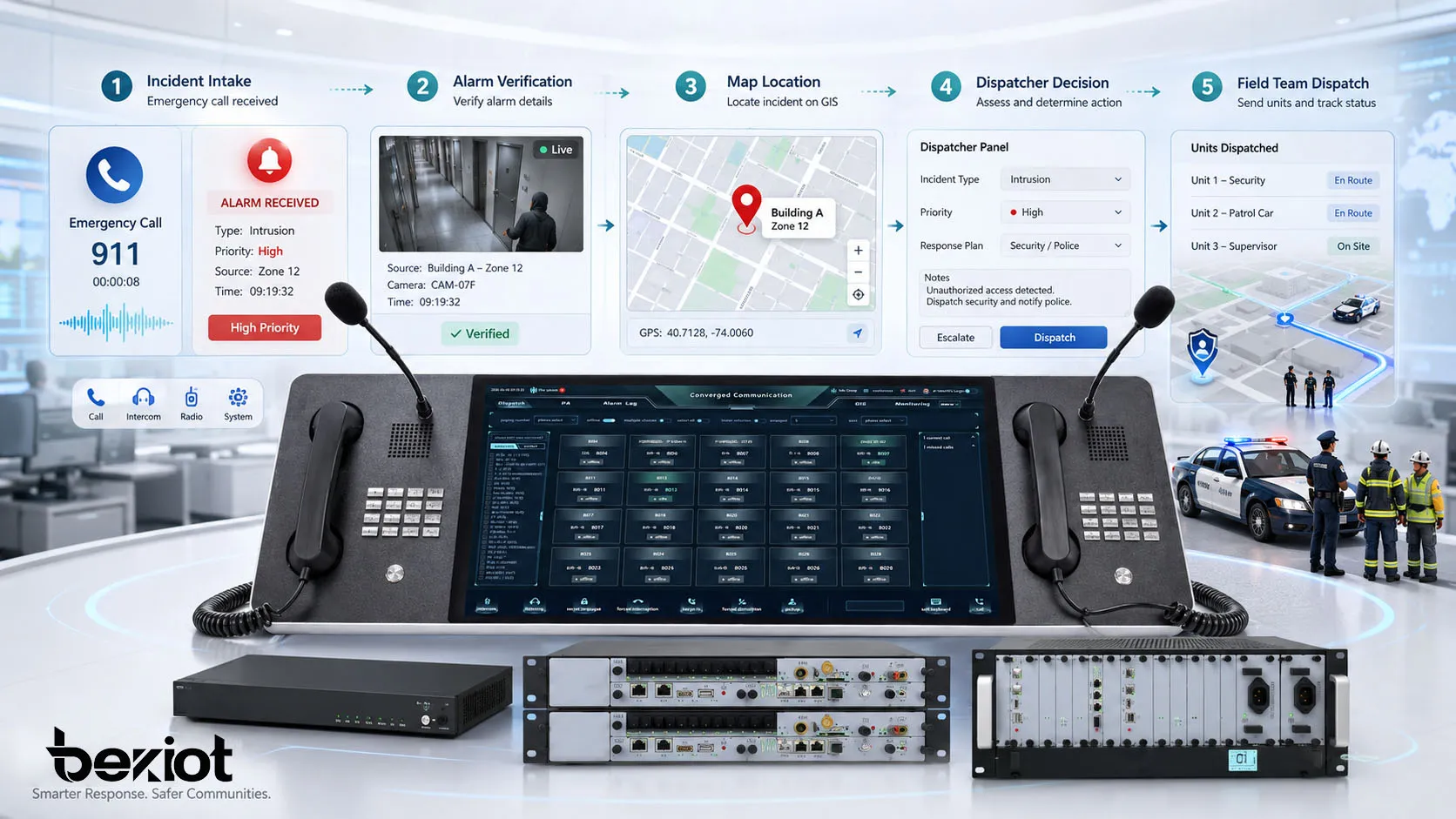

Le concept central n’est pas “mettre des GPU dans les stations”. Il s’agit de transformer la station de base en serveur IA de bord à faible latence, connecté en 5G puis 6G. Elle traite les signaux radio et exécute l’inférence IA pour utilisateurs, objets, véhicules, caméras, robots et systèmes industriels proches.

L’IA peut aussi améliorer le RAN : prédiction d’état de canal, identification dynamique des interférences multi-utilisateurs, optimisation des faisceaux millimétriques, prévision de trafic, économie d’énergie et ordonnancement radio. Ces fonctions peuvent améliorer la performance et réduire la complexité d’exploitation.

Dans l’edge computing, AI-RAN se situe entre cloud et terminal. Le cloud est puissant mais éloigné ; les terminaux sont proches mais limités ; les stations de base sont intermédiaires, plus proches que le cloud et plus puissantes que beaucoup d’équipements, donc adaptées à l’IA faible latence.

Les trois directions techniques de l’AI-RAN

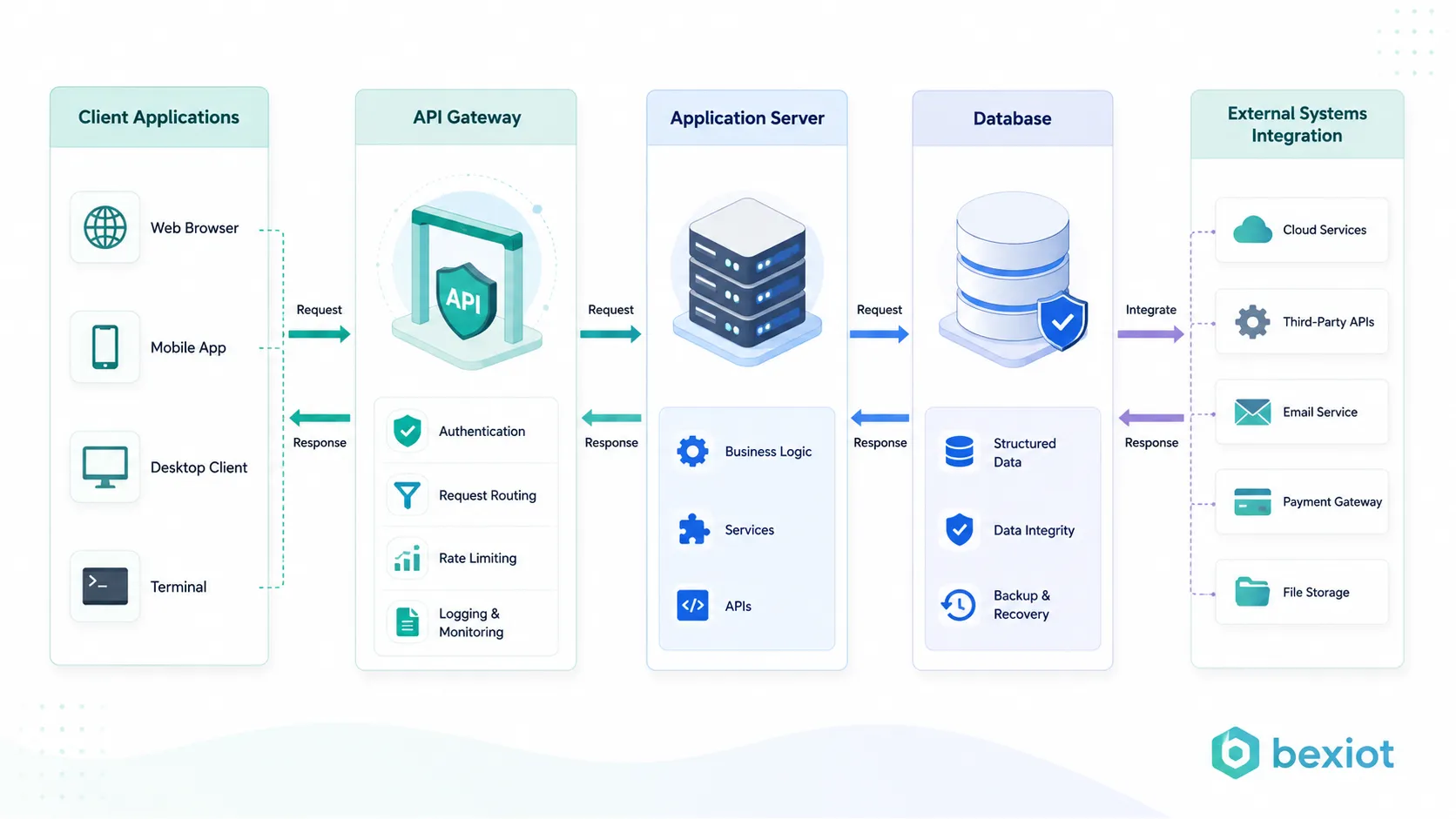

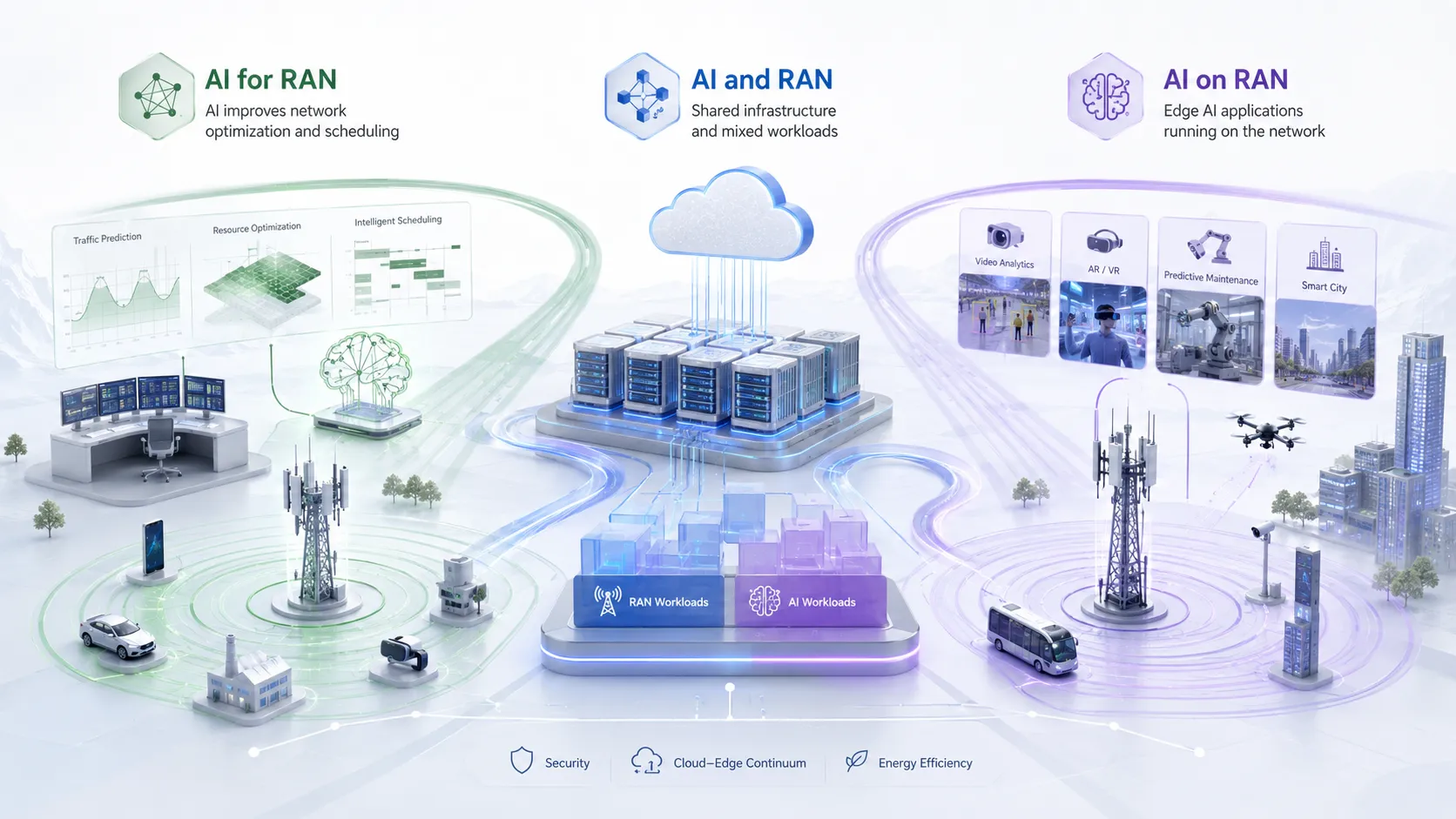

L’AI-RAN Alliance distingue AI for RAN, AI and RAN et AI on RAN. Elles sont différentes mais complémentaires.

AI for RAN

AI for RAN utilise l’IA pour améliorer le réseau radio : prédiction de trafic, ordonnancement intelligent, économie d’énergie, détection de panne, gestion d’interférences et beamforming.

C’est la voie la plus directe, car elle améliore le réseau lui-même et peut réduire les coûts d’exploitation.

AI and RAN

AI and RAN exécute fonctions de communication et fonctions IA sur la même infrastructure. Les charges RAN et IA partagent les ressources ; il faut les isoler, prioriser et équilibrer sans nuire au temps réel.

Cette direction détermine la rentabilité de la plateforme : un même matériel servant réseau et IA augmente l’utilisation des ressources.

AI on RAN

AI on RAN utilise l’infrastructure RAN pour des applications IA externes : analyse vidéo, positionnement industriel, systèmes autonomes, smart city, véhicules connectés, AR/VR et IA faible latence.

C’est le lien le plus fort avec la 6G, où les réseaux pourront transmettre, percevoir, calculer, analyser et coordonner l’intelligence à la périphérie.

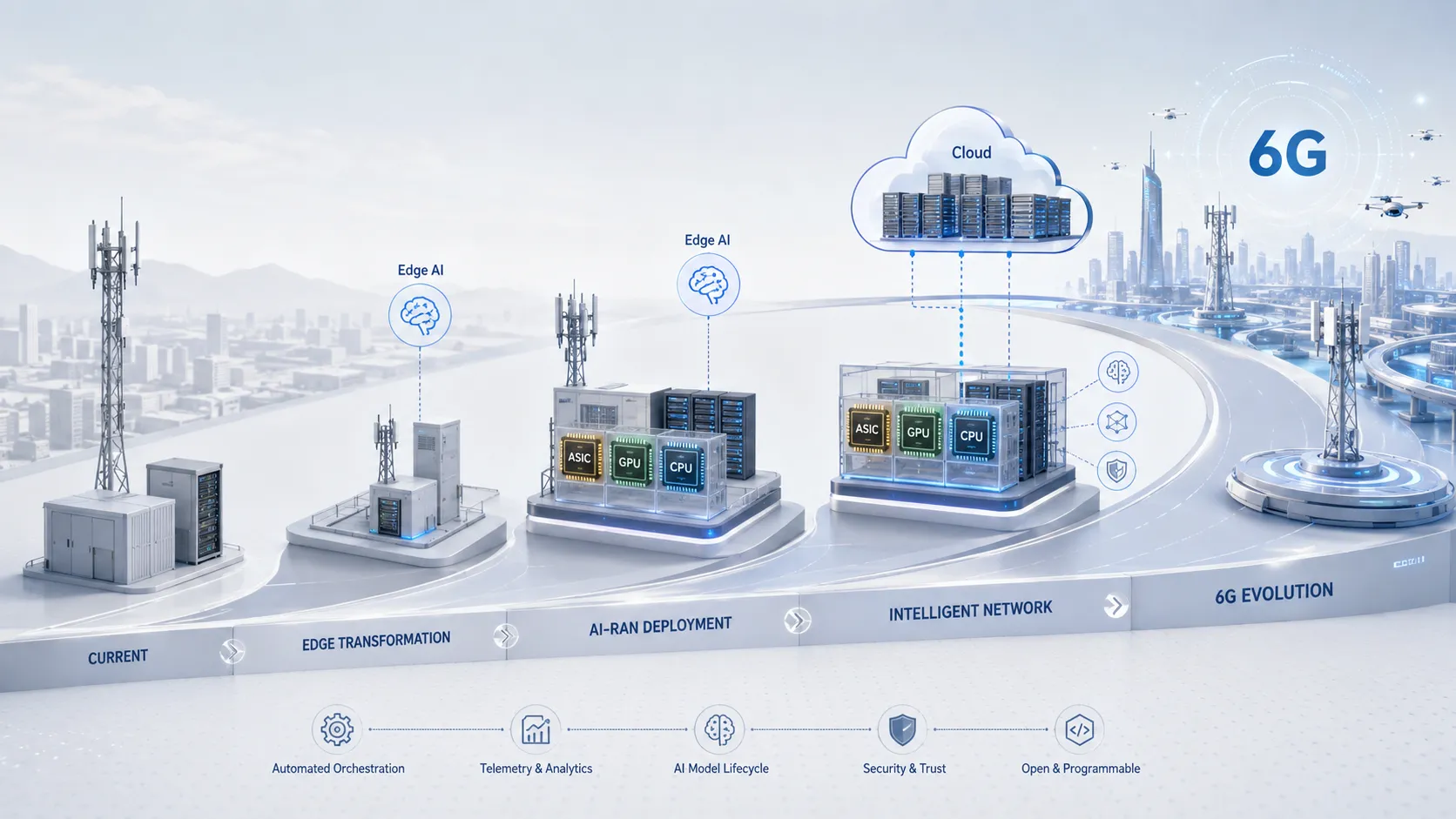

Progrès industriels de l’AI-RAN

En février 2024 au MWC de Barcelone, NVIDIA, SoftBank, Ericsson, Nokia, Microsoft et d’autres ont lancé l’AI-RAN Alliance, partie de 11 membres fondateurs puis étendue à plus de 100 opérateurs, fournisseurs et partenaires.

En novembre 2024, NVIDIA et SoftBank ont annoncé un essai présenté comme le premier réseau AI-RAN capable de traiter IA et 5G. En 2025, NVIDIA a investi 1 milliard USD dans Nokia, renforçant la coopération sur 6G RAN et AI-RAN.

NVIDIA a aussi lancé une solution complète avec Aerial RAN Computer Pro ou ARC-Pro et la plateforme AI Aerial, intégrant GB200, BlueField-3, Spectrum-X et bibliothèques CUDA-X pour usages télécom.

Avec ses partenaires, NVIDIA a ensuite promu “All-American AI-RAN” pour allouer dynamiquement les ressources GPU aux déploiements vRAN, applications IA et recherche 6G. En mars 2026, la vision AI Grid a présenté AI-RAN comme couche réseau et calcul de bord, avec orchestration cloud distribuée.

Deux voies industrielles : rejoindre ou construire indépendamment

La première voie adopte l’architecture GPU AI-RAN. SoftBank, AT&T et d’autres visent intelligence réseau, réduction OPEX, nouveaux services et avance 6G. Certaines estimations évoquent plus de 30% de réduction OPEX dans certains cas.

Nokia est visible avec son logiciel anyRAN intégré aux plateformes NVIDIA GPU AI RAN. En mars 2026, Nokia a annoncé des tests AI-RAN avec T-Mobile US, Telkom Indonesia et SoftBank.

La seconde voie est indépendante. Ericsson teste le RAN sur plateformes NVIDIA AI, mais intègre aussi un accélérateur neuronal programmable dans Ericsson Silicon pour rapprocher l’inférence IA des AAU et RRU.

Huawei et ZTE explorent aussi leurs routes : AI-Centric Network chez Huawei et AIR MAX chez ZTE. AI-RAN est donc une direction industrielle multi-chemins, non la solution d’un seul fournisseur.

Pourquoi les opérateurs sont intéressés et prudents

AI-RAN peut aider les opérateurs à dépasser le rôle de “tuyau passif”. Si les stations deviennent nœuds IA de bord programmables, elles peuvent créer des services d’inférence faible latence, applications industrielles, données exposées, réseaux privés et edge computing.

Certains parlent de passer de l’exploitation du trafic à l’exploitation de “tokens”, ou de fournisseur de connectivité à fournisseur de calcul. AI-RAN combine connectivité radio et calcul IA de bord.

Mais le risque est le verrouillage : si bande de base et inférence IA dépendent d’une plateforme GPU, le contrôle de l’architecture peut se déplacer vers cet écosystème, avec risques de souveraineté, chaîne d’approvisionnement, transparence des coûts et pouvoir de négociation.

Défis de déploiement

Le premier défi est le coût. Le CAPEX peut être élevé avec accélérateurs IA, serveurs, équipements réseau et upgrades de sites ; l’OPEX peut aussi monter avec consommation électrique, refroidissement, maintenance et exploitation.

Le deuxième défi est le modèle économique : comment mesurer, tarifer, vendre et exploiter l’IA de bord ? Comme cloud, slices réseau, services industriels ou nouvelle catégorie ?

Le troisième défi est la standardisation. 3GPP pilote les standards télécom, tandis que l’AI-RAN Alliance pousse ce domaine. Il manque encore un cadre unifié pour sémantique des données, interfaces de modèles, orchestration, scheduling et responsabilité commerciale.

Le quatrième défi est la maturité de l’écosystème : puces, équipements, opérateurs, clouds, terminaux, applications et modèles IA doivent choisir quelles routes soutenir.

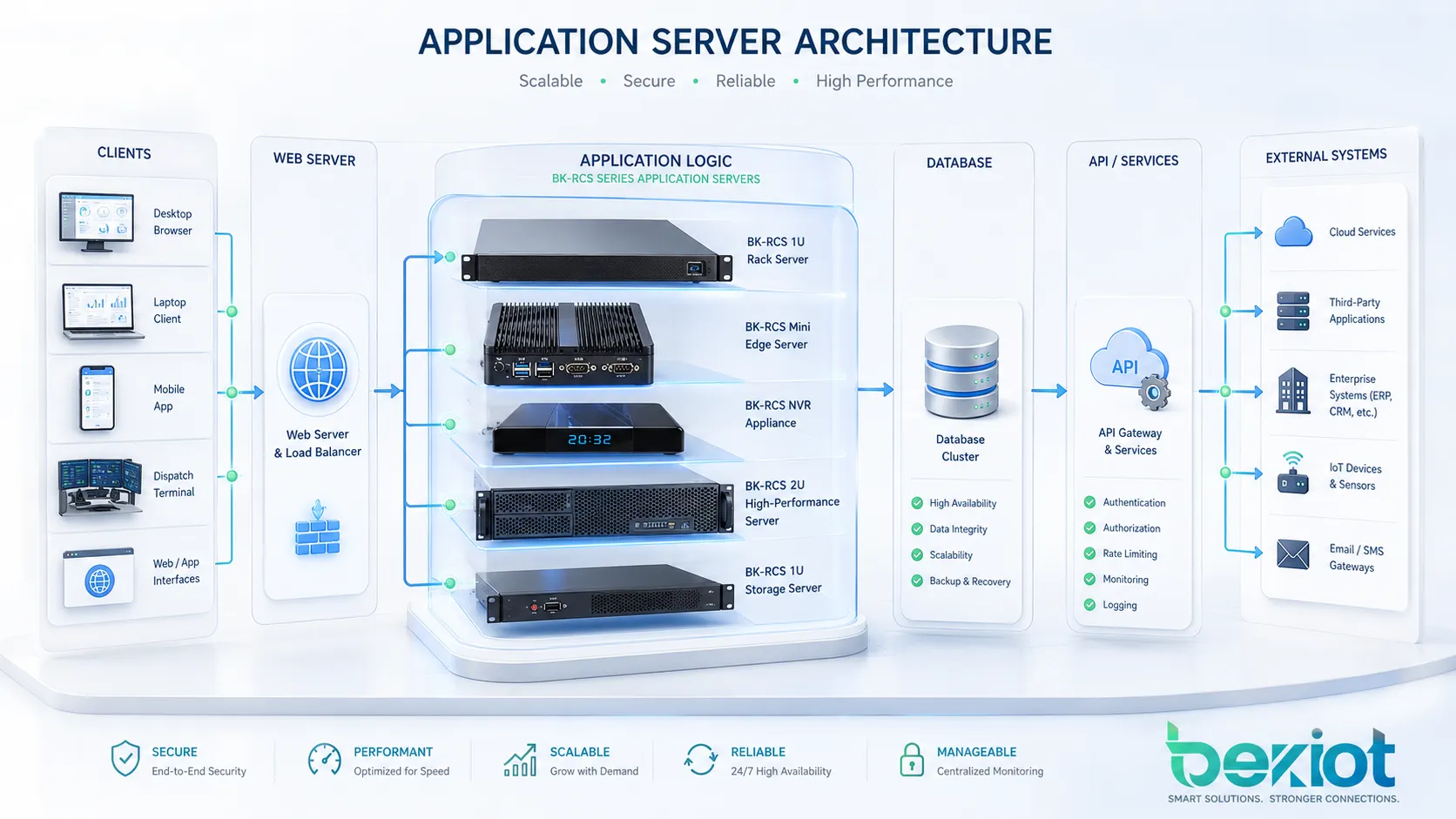

Pourquoi le calcul hétérogène peut être la vraie réponse

L’avenir ne sera probablement pas une architecture GPU pure. La voie réaliste combine ASIC + GPU + CPU et parfois FPGA.

Les ASIC sont efficaces pour charges télécom fixes ; les CPU assurent contrôle et services flexibles ; les GPU excellent en calcul IA parallèle et certaines charges RAN accélérées ; les FPGA servent l’accélération programmable spécialisée.

Cette architecture hybride évite la dépendance à une seule voie et permet un déploiement progressif : optimisation réseau, analyse vidéo de bord, positionnement industriel, réseaux privés et plateformes de recherche 6G.

Architecture de solution AI-RAN recommandée

Une solution pratique doit être en couches : couche radio RU, AAU, DU, CU ; couche calcul ASIC, CPU, GPU et éventuellement FPGA ; couche IA avec runtime de modèle, moteur d’inférence, traitement de données et optimisation ; couche orchestration pour scheduling, exposition de services, supervision et cycle de vie.

Les charges télécom doivent garder une performance déterministe. Les charges IA se planifient selon priorité, capacité et latence. Le RAN temps réel doit passer avant l’inférence non critique ; vidéo, positionnement et contrôle faible latence suivent les SLA.

Une couche sécurité et gouvernance est nécessaire : confidentialité, sécurité des modèles, contrôle d’accès, audit, isolation de services et reprise sur incident. AI-RAN relie réseau et IA, donc ses exigences de sécurité sont plus complexes.

Cas d’usage AI-RAN

Optimisation réseau

L’IA prédit le trafic, détecte les interférences, optimise les ressources radio, économise l’énergie et ajuste automatiquement le réseau.

Analyse vidéo en périphérie

Une station avec IA de bord peut traiter des flux vidéo pour sûreté publique, surveillance industrielle, trafic et campus intelligent, limitant l’envoi vers le cloud.

Réseaux privés industriels

Dans usines, ports, mines, énergie et logistique, AI-RAN combine 5G privée et inférence locale pour vision industrielle, robots, sécurité des travailleurs, inspection et monitoring faible latence.

Recherche 6G et réseaux natifs IA

AI-RAN peut devenir une base 6G, où communication, détection, calcul et intelligence sont intégrés.

Conclusion

AI-RAN relie évolution RAN, IA, edge, Open RAN, GPU et 6G. Il vise à transformer le réseau radio en plateforme intelligente de calcul de bord.

Mais le domaine reste précoce. Depuis 2024, les progrès sont rapides, sans garantie de succès commercial massif. CAPEX, OPEX, énergie, verrouillage fournisseur, modèle économique, standards et écosystème restent difficiles.

L’avenir probable est hétérogène, progressif, ouvert et orienté 6G. AI-RAN peut devenir central, mais demande déploiements réels et validation commerciale.

FAQ

Que signifie AI-RAN ?

Artificial Intelligence Radio Access Network : application de l’IA au réseau d’accès radio et intégration des charges radio et IA.

Est-ce seulement mettre des GPU dans les stations ?

Non. Les GPU comptent, mais AI-RAN inclut optimisation IA, infrastructure partagée et plateforme d’IA de bord.

Que sont AI for RAN, AI and RAN et AI on RAN ?

AI for RAN améliore le réseau ; AI and RAN partage l’infrastructure ; AI on RAN utilise le RAN comme plateforme d’applications IA.

Pourquoi est-ce important pour la 6G ?

La 6G devrait intégrer communication, détection, calcul et intelligence ; AI-RAN fournit une base edge et native IA.

Quels sont les plus grands défis ?

CAPEX, OPEX, énergie, verrouillage fournisseur, modèle économique incertain, absence de standards unifiés et écosystème immature.

Quelle architecture est la plus probable ?

Une architecture hétérogène combinant ASIC, GPU, CPU et parfois FPGA pour équilibrer performance, efficacité, coût et contrôle.