Les systèmes de communication convergente sont utilisés dans le commandement d’urgence, la sécurité publique, le secours incendie, le dispatch industriel, le transport et les grands projets de sûreté. Un opérateur peut coordonner voix, radio, vidéo, alarmes et ressources terrain depuis une même plateforme.

Mais beaucoup de projets rencontrent un problème caché : la compatibilité vidéo est plus difficile que prévu. Le défi réel ne consiste pas seulement à connecter une caméra au réseau, mais à gérer l’encodage, les protocoles, le décodage des terminaux, le support navigateur et la performance temps réel.

La faille cachée des projets de dispatch unifié

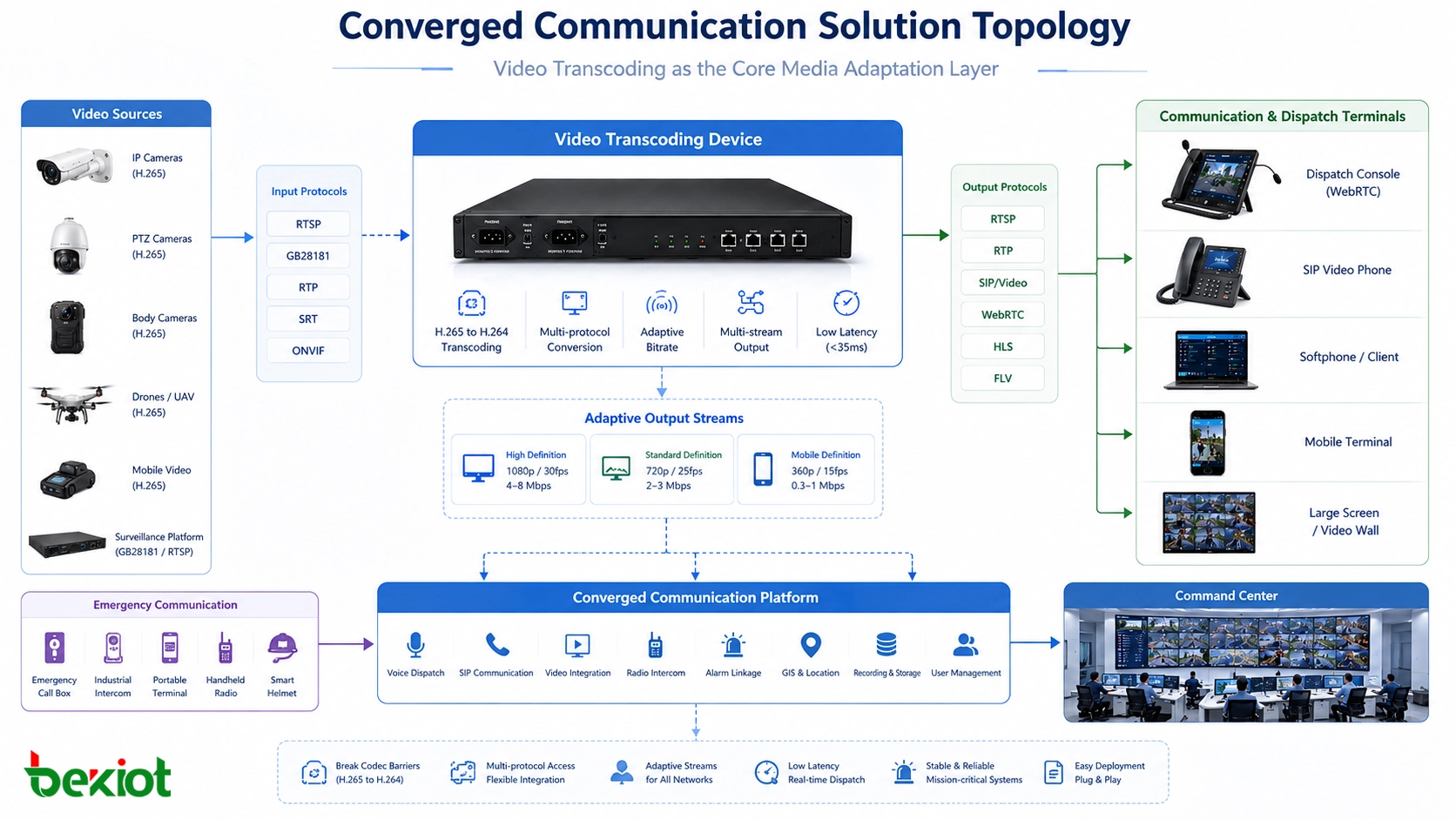

De nombreux projets sont conçus autour d’une plateforme de commandement unifiée avec dispatch voix, réunions vidéo, appels SIP, interconnexion radio, alarmes, GIS et intégration vidéo.

Sur le schéma tout semble connecté, mais lors du déploiement réel l’accès vidéo devient souvent le point faible. Une caméra lisible dans un VMS traditionnel ne l’est pas forcément dans une console WebRTC ou un terminal de communication.

Caméra, plateforme, navigateur, terminal et serveur média peuvent utiliser des formats et méthodes de décodage différents. La couche vidéo doit donc être prévue dès l’architecture centrale.

La cause principale est l’encodage vidéo

Les systèmes de surveillance ont largement adopté H.265. À qualité comparable, il peut réduire le débit de près de moitié par rapport à H.264.

Dans les réseaux urbains, parcs industriels, transports, sites énergétiques et sécurité publique, ce gain réduit la charge réseau et améliore le stockage.

Mais les plateformes convergentes reposent souvent sur WebRTC, dont la prise en charge H.265 reste incomplète dans les navigateurs courants.

Pourquoi WebRTC ne décode pas tous les flux caméra

WebRTC est apprécié pour l’audio-vidéo temps réel dans les navigateurs et clients logiciels, notamment pour les consoles, appels vidéo et centres de commandement.

Il ne résout pourtant pas tous les formats. De nombreuses caméras sortent en H.265 alors que les environnements WebRTC utilisent surtout H.264 ou des formats supportés par le navigateur.

Le problème existe aussi côté terminaux : beaucoup de téléphones IP, clients logiciels et équipements terrain ne disposent pas d’un décodage matériel H.265 suffisant.

Dans un projet convergent, la question n’est pas seulement de savoir si le flux existe, mais si chaque terminal peut le décoder, l’afficher et l’utiliser en temps réel.

Les serveurs média ne sont pas toujours faits pour convertir en temps réel

Beaucoup de plateformes utilisent des cadres SIP et média matures, excellents pour la voix, la signalisation, les conférences et le contrôle d’appel.

Le transcodage vidéo est bien plus lourd que le relais audio. Dans de nombreuses architectures, le serveur média transmet plutôt qu’il ne convertit massivement en temps réel.

Faire porter cette charge au serveur central augmente la complexité et peut affecter la stabilité. Un appareil dédié prend la conversion en amont.

Une couche dédiée devient nécessaire

Dans les projets avec accès vidéo, le transcodeur doit être considéré comme une infrastructure. Il traduit les formats entre le réseau de surveillance et le réseau de communication.

Il convertit les flux H.265 provenant de caméras, sources mobiles, enregistreurs ou plateformes existantes vers H.264 ou d’autres formats utilisables.

La performance temps réel est essentielle. En commandement, la vidéo ne doit pas rester derrière les instructions vocales et la latence doit rester compatible avec la décision opérationnelle.

Les flux adaptatifs sont essentiels

La conversion de codec n’est qu’une partie du besoin. Les terminaux sont variés : grands écrans HD en LAN gigabit, mobiles 4G, clients logiciels et équipements de terrain.

Le dispositif doit adapter résolution, fréquence d’images et débit. Une même source peut produire plusieurs profils pour différents terminaux.

Un flux unique très lourd provoque gels, retard ou échec de lecture. L’adaptation améliore la stabilité globale.

La fragmentation des protocoles est un autre obstacle

L’écosystème convergent peut combiner SIP, GB/T 28181, RTP, RTSP, FLV, HLS, WebRTC et d’autres protocoles.

Chaque protocole peut appartenir à une plateforme ou à un fournisseur différent. Le transcodeur doit donc faire plus que convertir H.265 en H.264.

Des entrées et sorties flexibles réduisent le développement spécifique et facilitent l’interconnexion entre caméras, plateformes, navigateurs, mobiles et systèmes de communication.

À quoi ressemble une architecture pratique

L’architecture place généralement le transcodeur entre la vidéosurveillance et la plateforme de communication.

Il reçoit les flux de caméras, plateformes GB/T 28181, sources RTSP ou autres systèmes, puis fournit des flux adaptés aux consoles WebRTC, terminaux SIP, navigateurs, écrans et clients logiciels.

Ainsi la plateforme se concentre sur le commandement, les utilisateurs, les appels, les alarmes et la logique de dispatch, tandis que la couche de transcodage gère médias et protocoles. Becke Telcom peut l’intégrer dans une solution convergente.

Risques si le transcodage est ignoré

Les transcodeurs sont souvent sous-estimés, car ils sont moins visibles que consoles, serveurs d’enregistrement, murs vidéo ou terminaux.

En livraison, on peut rencontrer incompatibilités de codec, échecs navigateur, limites de décodage, débit excessif, protocoles non supportés ou relais instable.

Ces problèmes nuisent au commandement. À la recette, l’utilisateur vérifie ouverture rapide, clarté, latence et affichage sur plusieurs terminaux.

Critères de choix pour le projet

Il faut d’abord confirmer les sources : codec caméra, protocole, résolution, fréquence, débit et méthode d’accès. H.265 exige une attention particulière.

Il faut ensuite confirmer les sorties : H.264, flux WebRTC, HLS navigateur, RTSP interne ou autres formats, avec plusieurs profils si nécessaire.

Enfin il faut tester le comportement réel : faible latence, décodage stable, commutation fluide et accès multi-terminaux avec les vrais équipements.

| Domaine de conception | Exigence clé | Valeur projet |

|---|---|---|

| Conversion codec | Convertir H.265 vers H.264 ou autre format | Rend la surveillance utilisable avec WebRTC et terminaux |

| Faible latence | Maintenir un délai adapté au dispatch | Évite que la vidéo retarde les décisions |

| Sortie adaptative | Ajuster résolution, fréquence et débit | Améliore l’accès en LAN, 4G et réseaux mixtes |

| Compatibilité protocolaire | Supporter SIP, GB/T 28181, RTP, RTSP, FLV, HLS, WebRTC | Réduit la difficulté d’intégration |

| Intégration système | Travailler avec plateformes, vidéo, navigateurs et terminaux | Fait de la vidéo une partie fiable du commandement |

Où cette couche est la plus utile

Le transcodage est utile dès que la vidéo de surveillance doit entrer dans un environnement de communication ou de dispatch : urgences, sécurité publique, industrie, transport, énergie, ports, mines, campus et grands sites.

En urgence, la vidéo aide à comprendre le terrain ; en industrie, elle soutient inspection, confirmation de défaut et sécurité ; dans le transport, elle coordonne stations, tunnels et maintenance.

L’exigence commune est que la vidéo soit utilisable dans le flux de communication, et non isolée dans une plateforme de surveillance.

Conclusion

Un vrai projet convergent ne peut pas dépendre seulement de la voix, du SIP et de l’intégration plateforme. Si la vidéosurveillance est présente, le transcodage doit être inclus.

Un dispositif dédié convertit les codecs, adapte débit, fréquence et résolution, et relie SIP, GB/T 28181, RTP, RTSP, FLV, HLS et WebRTC.

Pour les ingénieurs, le message est clair : le transcodage vidéo est la base qui rend la vidéo de surveillance réellement utilisable, temps réel et fiable dans la communication convergente.

FAQ

Pourquoi ces projets ont-ils besoin de transcodage vidéo ?

Parce que beaucoup de caméras sortent en H.265 alors que les consoles WebRTC, navigateurs, téléphones IP et terminaux ne le décodent pas toujours.

H.265 est-il meilleur que H.264 ?

H.265 est plus efficace en stockage et bande passante, mais H.264 reste plus largement supporté par les terminaux et navigateurs.

La plateforme peut-elle transcoder seule ?

Pas toujours. Le transcodage temps réel consomme beaucoup de ressources ; un appareil dédié est souvent plus stable et pratique.

Quels protocoles faut-il supporter ?

SIP, GB/T 28181, RTP, RTSP, FLV, HLS, WebRTC et les flux nécessaires aux caméras, plateformes et terminaux du projet.

Que se passe-t-il si on l’ignore ?

Écrans noirs, flux non supportés, forte latence, vidéo floue, lecture instable ou incompatibilités découvertes tardivement.